- Accueil

- IA & Banque : conjuguer innovation technologique et exigences réglementaires

IA & Banque : conjuguer innovation technologique et exigences réglementaires

- L’IA transforme la banque à une vive allure

- Des impacts dans toutes les opérations bancaires

- Une adoption rapide qui exige un cadre maîtrisé

- Plongée dans les technologies et les défis d’explicabilité

- Bâtir une IA de confiance – cadres, gouvernance et compétences

- Monter en compétences pour piloter une IA responsable

- Feuille de route pour un déploiement responsable

- Une IA bancaire durable : conformité, explicabilité et pilotage

L’intelligence artificielle redessine rapidement les pratiques bancaires. Automatisation, analyse experte des risques, amélioration des parcours clients : les usages se multiplient. Mais cette dynamique ne peut se développer que dans un cadre clair, où la transparence, la conformité et la compréhension des décisions restent essentielles. L’IA bancaire avance ainsi sur une ligne de crête : porter l’innovation tout en préservant la confiance.

L’IA transforme la banque à une vive allure

Depuis quelques années, l’intelligence artificielle s’est imposée comme un levier de transformation majeur des opérations bancaires.

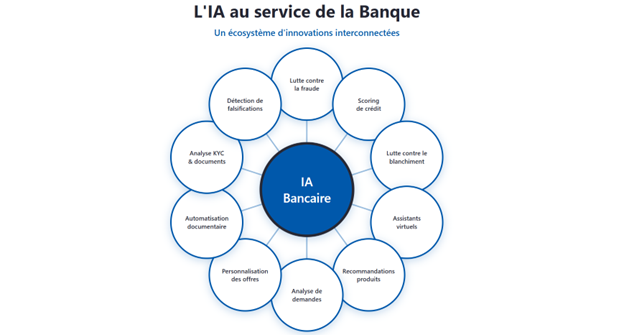

Des impacts dans toutes les opérations bancaires

L’IA apporte désormais des bénéfices concrets à toutes les étapes de la chaîne de valeur. Dans la lutte contre la fraude, elle permet d’identifier des schémas anormaux en temps réel. Dans la lutte contre le blanchiment, elle renforce la pertinence des alertes et réduit les faux positifs. Le scoring de crédit gagne en finesse et en réactivité grâce à des modèles capables d’intégrer de nouvelles données plus rapidement.

La relation client évolue également : assistants virtuels, analyse automatique de demandes écrites ou orales, génération de synthèses pour les conseillers. En back-office, les solutions d’automatisation documentaire accélèrent la prise en charge et améliorent la qualité des contrôles.

Une adoption rapide qui exige un cadre maîtrisé

Cette diffusion s’explique par un double mouvement : une maturité technologique accrue et une acculturation progressive des équipes. Mais cette accélération appelle une vigilance renforcée. Les modèles d’IA déployés doivent rester maîtrisés, compréhensibles et conformes aux attentes des superviseurs.

Les regulatory sandboxes, proposées par certaines autorités, contribuent précisément à cet équilibre. Ces “bacs à sable réglementaires” offrent aux institutions financières un cadre sécurisé pour expérimenter des solutions d’IA en conditions réelles, mais sous surveillance et avec des limites clairement définies (durée, périmètre, volume de données, etc.).

Plongée dans les technologies et les défis d’explicabilité

L’explicabilité en IA désigne la capacité d’un système à rendre ses processus de décision et ses résultats compréhensibles, transparents et justifiables pour un être humain, transformant ainsi la “boîte noire” algorithmique en un outil auditable et digne de confiance.

Derrière cette transformation, plusieurs technologies se distinguent : NLP, LLM, vision par ordinateur, machine learning, etc.

Grands modèles de langage et technologies émergentes

Les modèles de traitement du langage naturel (NLP) permettent de comprendre les demandes des clients formulées en langage courant et de produire automatiquement des synthèses de textes réglementaires. L’émergence des grands modèles de langage (LLM), comme GPT, ouvre de nouvelles perspectives, notamment pour accompagner les développeurs ou faciliter la lecture de normes complexes. La confidentialité des données reste toutefois un enjeu majeur.

La vision par ordinateur s’impose dans l’analyse automatisée de documents d’identité ou dans la lecture intelligente de documents numérisés. Le machine learning, parfois associé à des approches hybrides combinant règles et algorithmes, offre un équilibre entre rigueur et flexibilité. C’est particulièrement vrai pour les modèles d’évaluation des risques, où la traçabilité et l’auditabilité sont essentielles.

La Banque Postale : un exemple concret d’IA responsable

La Banque Postale a mis en place un système d’analyse intelligente des pièces justificatives pour l’ouverture de compte, associé à la détection automatique de documents falsifiés. Entraînée sur des bases certifiées, la solution est auditée en continu par les équipes conformité, garantissant le respect des exigences RGPD et des normes ACPR.

Ces innovations techniques posent cependant une question centrale : comment garantir l’équité des traitements, la transparence des décisions et l’absence de biais discriminants ? Dans ce contexte, la confiance devient le fil conducteur du développement responsable de l’IA bancaire.

Bâtir une IA de confiance – cadres, gouvernance et compétences

Le secteur bancaire évolue sous une forte pression réglementaire :

- Le RGPD impose le droit à l’explication des décisions algorithmiques.

- Le règlement européen DORA renforce les exigences en matière de résilience numérique.

- L’AI Act qualifie les systèmes utilisés dans la banque comme “à haut risque”, nécessitant une documentation approfondie, des audits réguliers et une gouvernance adaptée.

Les régulations prudentielles, telles que Bâle III, complètent ce cadre en exigeant que les modèles internes soient compréhensibles et traçables. Dans ce contexte, certaines banques pionnières, comme le Crédit Mutuel avec Watson, HSBC ou ING, ont très tôt intégré des dispositifs de contrôle et de redevabilité de l’IA.

Monter en compétences pour piloter une IA responsable

Pour suivre cette dynamique, la montée en compétences constitue un levier stratégique. Capgemini Institut propose plusieurs parcours de formations adaptés au secteur financier, permettant aux collaborateurs de mieux comprendre les technologies et leurs impacts afin de structurer leur gouvernance :

- Mise en œuvre de l’IA Générative dans la Banque, l’Assurance et les Mutuelles — pour appréhender les cas d’usages concrets, les bonnes pratiques de mise en œuvre et les enjeux éthiques.

- L’IA dans votre organisation : assurer la conformité de vos projets — pour outiller décideurs et juristes dans la qualification des solutions et de gouvernance.

- Gouvernance de l’IA : processus et outils pour rester conforme — pour mettre en place les processus et outils nécessaires à une feuille de route réglementaire et auditable

Ces formations permettent d’asseoir un pilotage sûr et responsable des projets IA, en lien avec les attentes des régulateurs et les enjeux éthiques.

Feuille de route pour un déploiement responsable

Les initiatives les plus avancées en matière d’IA bancaire reposent sur une organisation transversale et une planification rigoureuse. Elles combinent gouvernance partagée, intégration de la conformité et sécurisation technique, tout en entretenant un dialogue constant avec les régulateurs.

Première étape : mettre en place une gouvernance partagée

Il s’agit de constituer un comité IA impliquant la Direction des Systèmes d’Information, les équipes risques, la conformité et les data scientists. Ce comité assure un alignement des priorités, supervise le déploiement des modèles et garantit une surveillance opérationnelle continue.

Deuxième étape : intégrer la conformité “by design”

Chaque projet doit inclure dès sa conception une documentation complète des données utilisées, une explicabilité claire des modèles, une gestion proactive des biais et des tests de robustesse réguliers. Cette approche “by design” permet de sécuriser les décisions et de renforcer la confiance dans les systèmes déployés.

Troisième étape : sécuriser la chaîne de valeur technique

La protection des modèles passe par un contrôle strict des accès, le chiffrement des données, la supervision en temps réel et une gestion complète du cycle de vie des modèles. Société Générale illustre parfaitement cette démarche avec un protocole de validation multicritères(2). Avant leur déploiement, chaque modèle est évalué selon son niveau de robustesse et audité par le service juridique. Les modèles qui ne répondent pas aux standards d’explicabilité sont soit retravaillés, soit rejetés, jusqu’à atteindre le niveau d’exigence minimal.

Quatrième étape : construire une relation transparente avec le régulateur

Enfin, la relation avec les autorités de contrôle doit s’inscrire dans un esprit de transparence et d’amélioration continue. La participation aux regulatory sandboxes, les audits volontaires et la mise en place de comités d’éthique internes contribuent à consolider la confiance et à anticiper les évolutions réglementaires.

Une IA bancaire durable : conformité, explicabilité et pilotage

L’adoption pérenne de l’IA dans le secteur bancaire repose sur un équilibre délicat entre la volonté d’innover et la nécessité de rassurer. La réglementation, loin de constituer un obstacle, joue un rôle de catalyseur en favorisant des solutions plus fiables, transparentes et mieux acceptées.

La compétence des équipes devient alors un facteur clé pour transformer cette ambition en réalité. En s’appuyant sur l’expertise de Capgemini Institut, les établissements financiers peuvent structurer une stratégie IA qui soit à la fois conforme, performante et durable, garantissant ainsi un déploiement responsable et maîtrisé.

Sources

- L’IA dans la banque : une révolution sous haute surveillance

- Société Générale partage sa stratégie d’intégration de l’IA générative dans le secteur financier